Paper Reading Mar16 - Mar22

Paper List:

OpenClaw-RL: Train Any Agent Simply by Talking

Abstract

每一次智能体交互都会产生一种“下一状态”信号,也就是某个动作之后随之而来的用户回复、工具输出、终端状态变化或 GUI 状态变化。然而,现有的 agentic RL 系统都没有把它作为一种在线、实时的学习来源来加以利用。

我们提出了 OpenClaw-RL,这是一个建立在一个简单观察之上的框架:下一状态信号是普适存在的,策略可以同时从所有这类信号中学习。 个人对话、终端执行、GUI 交互、SWE 任务以及工具调用轨迹,并不是彼此割裂的训练问题;它们本质上都是交互过程,因此都可以放进同一个循环中,用来训练同一个策略。

下一状态信号包含两类信息:

- 评估性信号(evaluative signals):表示动作执行得有多好,我们通过一个 PRM judge 将其提取为标量奖励。

- 指导性信号(directive signals):表示这个动作本来应该如何做得更好,我们通过 Hindsight-Guided On-Policy Distillation(OPD) 来恢复这类信息。

具体来说,我们从下一状态中提取文本提示,构造一个增强版教师上下文,并提供一种 token 级别的方向性优势监督,这种监督比单纯的标量奖励更加丰富。

由于系统采用了异步设计,模型可以一边服务实时请求,PRM 一边对正在进行的交互做评判,训练器也可以同时更新策略,三者之间无需额外协调开销。

在个人智能体场景中,OpenClaw-RL 使得智能体能够在被使用的过程中持续改进:它可以从用户的再次提问、纠正以及显式反馈中恢复对话信号并学习。

在通用智能体场景中,同一套基础设施也支持在终端、GUI、SWE 和工具调用等环境中进行可扩展的强化学习;此外,我们还进一步展示了 过程奖励(process rewards) 的实际价值。

Key Points

Understanding

daVinci-Env: Open SWE Environment Synthesis at Scale

Abstract

训练具备软件工程(SWE)能力的智能体,需要大规模、可执行且可验证的环境,以提供动态反馈闭环,支持迭代式代码编辑、测试执行和解法优化。然而,现有开源数据集在规模和仓库多样性上仍然受限,而工业界方案又通常不透明,且基础设施并未公开发布,这对大多数学术研究团队构成了很高的门槛。

我们提出了 OpenSWE,这是目前规模最大的、完全透明的 Python 软件工程智能体训练框架,包含 45,320 个可执行 Docker 环境,覆盖 12,800 多个代码仓库,并且其所有 Dockerfile、评测脚本以及基础设施都已完全开源,从而保证可复现性。

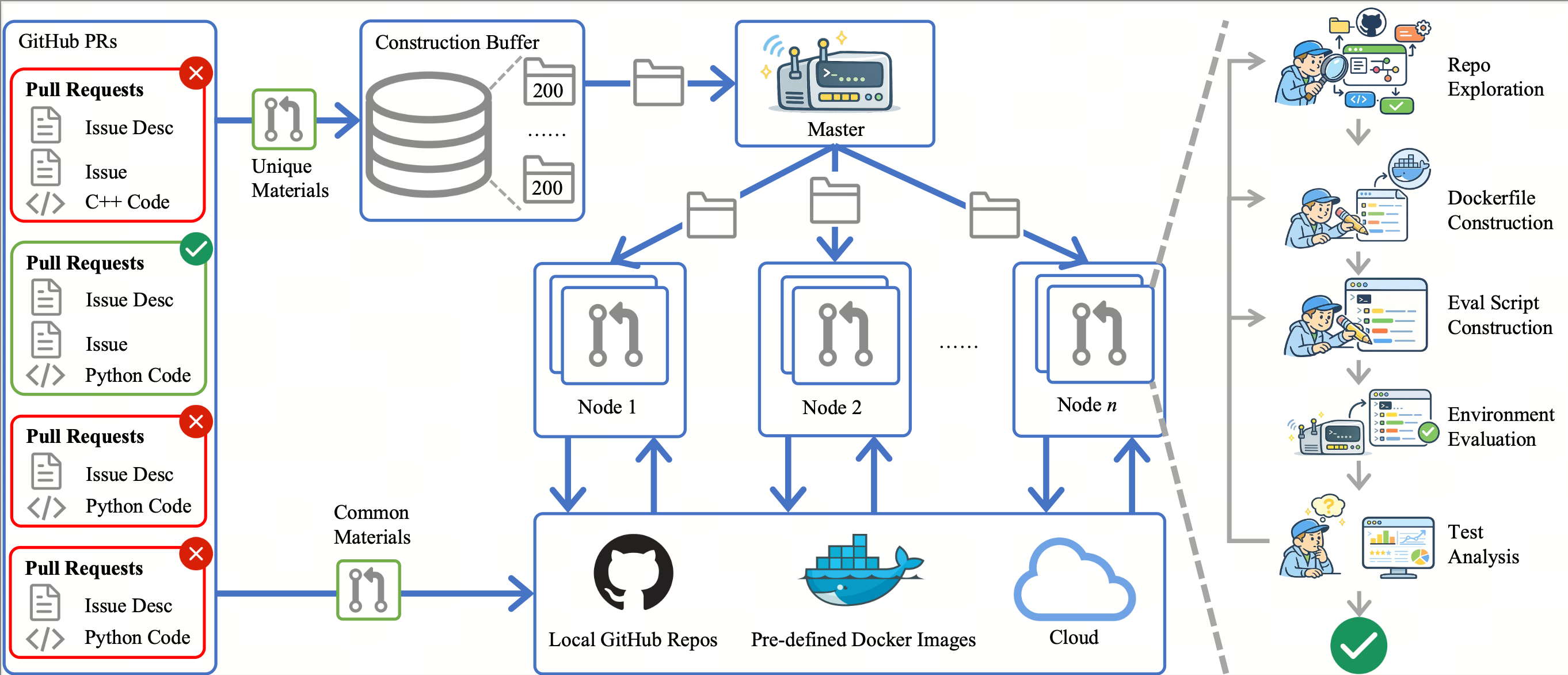

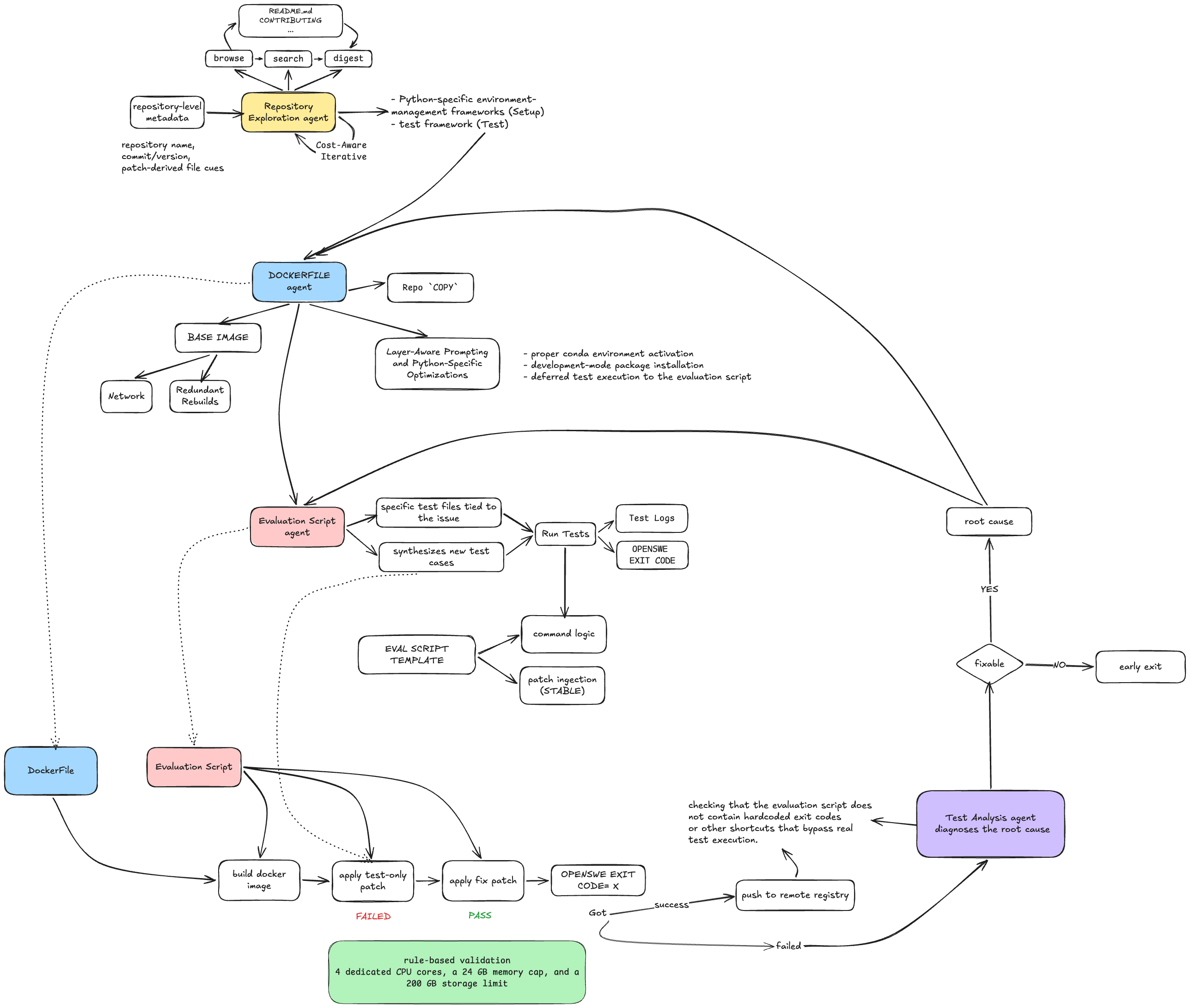

OpenSWE 通过部署在 64 节点分布式集群上的多智能体合成流水线构建,能够自动完成仓库探索、Dockerfile 构建、评测脚本生成以及迭代式测试分析。

除了规模之外,我们还提出了一套以质量为中心的过滤流水线,用于刻画每个环境的内在难度,过滤掉那些要么无法求解、要么挑战性不足的实例,只保留最能提升学习效率的数据。

在成本方面,环境构建花费了 89.1 万美元,轨迹采样与基于难度的筛选额外花费 57.6 万美元,整个项目总投入约为 147 万美元。最终产出了大约 13,000 条精筛轨迹,这些轨迹来自约 9,000 个质量有保证的环境。

大量实验验证了 OpenSWE 的有效性:OpenSWE-32B 和 OpenSWE-72B 在 SWE-bench Verified 上分别达到 62.4% 和 66.0%,在 Qwen2.5 系列模型中建立了新的最先进结果(SOTA)。

在所有设置下,基于 OpenSWE 训练的模型都持续优于基于 SWE-rebench 训练的模型,并且数据规模扩展呈现出对数线性增长趋势,尚未出现饱和。

此外,面向 SWE 的训练还带来了显著的域外泛化收益:在数学推理任务上最高提升 12 个点,在科学类基准上最高提升 5 个点,同时并未损害事实性记忆能力。

所有环境和评测脚本现已公开发布于:https://github.com/GAIR-NLP/OpenSWE

Key Points

主要挑战:

- 环境规模与多样性:需要大规模、可执行且可验证的环境来训练具备软件工程能力的智能体。

- 现有开源数据集在规模和仓库多样性上受限,工业界方案不透明且基础设施未公开发布。

- 数据质量:需要过滤掉那些无法求解或挑战性不足的

相关工作:

- SWE-agent

- SWE-rebench

- SWE-Universe

- SWE-Factory

- SWE-World

GitHub PR Filtering

- 至少5 stars

- 只保留主语言为Python

- PR必须要有对应Issue, 以及description

- 必须有实质性代码更改, 不能仅仅是对测试文件进行修改

Understanding

Neural Thickets: Diverse Task Experts Are Dense Around Pretrained Weights

Abstract

Key Points

Understanding

Attention Residuals

Paper Reading Mar16 - Mar22